註:本文同步更新在Notion!(數學公式會比較好閱讀)

深度信念網路(Deep Belief Networks, DBN) 是一種結合無監督學習與監督學習的深度神經網路結構,最早由 Geoffrey Hinton 提出。它是建立在侷限型波茲曼機(Restricted Boltzmann Machines, RBM)的基礎上,通過逐層預訓練學習數據的隱含特徵,然後再進行細調。DBN 主要用於解決高維數據集上的分類、降維、特徵提取以及生成模型等問題。

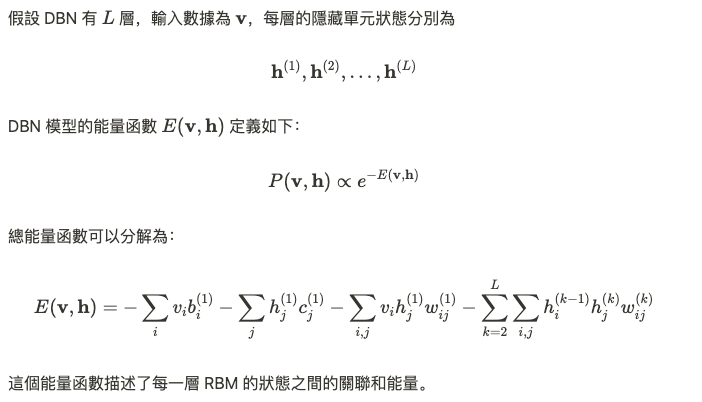

DBN 是一種分層生成模型,它的結構由多個 RBM 層堆疊而成。每一層的隱藏單元學習來自前一層輸出的特徵,並且這些隱藏單元通過概率模型對數據進行建模。DBN 可以看作是一個無向生成模型和有向生成模型的混合體

DBN 的訓練分為兩個主要階段:逐層無監督預訓練和有監督微調。

逐層無監督預訓練

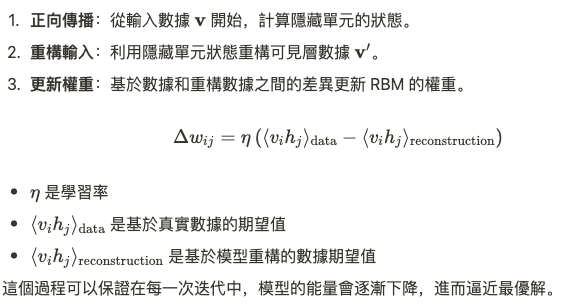

在預訓練階段,DBN 通常採用逐層訓練的方式。具體來說,首先訓練底層的 RBM,然後將該層的隱藏單元輸出作為下一層的輸入進行訓練。每一層的訓練過程主要是基於對比散度(Contrastive Divergence)進行。

有監督微調

在完成預訓練後,DBN 會進行微調。微調是基於監督學習的方法,如反向傳播算法(Backpropagation),以優化模型的最終性能。這個過程主要用於根據具體的目標函數(如分類或回歸任務)調整模型參數。

DBN 的預訓練過程核心在於對比散度(Contrastive Divergence, CD),這是一種基於馬可夫鏈蒙地卡羅(Markov Chain Monte Carlo, MCMC)的近似算法,用來估計無監督學習中的數據分佈。

與前饋神經網路(Feedforward Neural Networks, FNN)不同,DBN 是一種生成模型,它能夠生成與輸入數據相似的新數據。此外,與卷積神經網路(Convolutional Neural Networks, CNN)相比,DBN 更擅長處理無監督學習任務。

DBN 的一個顯著優勢在於它能夠通過逐層預訓練有效避免梯度消失問題,這使得它在早期的深度學習應用中非常流行。然而,隨著更為強大的深度模型(如卷積神經網路和長短期記憶網路)的發展,DBN 在某些領域的應用逐漸減少,但其基於概率生成的特性仍然在無監督學習和生成任務中具有一定的競爭力。

深度信念網路是深度學習領域中的重要模型,特別是在無監督學習和生成任務中表現突出。DBN 的結構通過逐層預訓練和細調,使得它能夠有效學習數據中的隱含特徵並生成與原始數據相似的樣本。儘管隨著其他更為高效的模型的出現,DBN 在某些領域的應用有所減少,但其在特徵學習、數據生成和降維上的應用依然具有價值。